2024年5月27日,數發部於立法院交通委員會提出「數位三箭齊發」計畫,推動打擊詐騙、強化數位韌性並發展數位經濟。其中,數發部計畫於3個月內建構「打詐通報查詢網」,以人工智慧對抗AI假訊息。針對此政策,我們可以借鑒美、歐的相關政策經驗,以確保該計畫能成功實施,及產生長期的抑AI制詐欺效果。

美國的政策措施

一、禁止未經同意的AI生成聲音:2024年2月,美國聯邦通訊委員會(FCC)禁止未經同意的AI生成聲音用於冒用。主因在 1 月新罕布夏州總統初選之前,居民接到了AI機器人電話,以人工智慧生成拜登總統的聲音,告訴選民不要去投票站投票,引起社會譁然。

二、政治廣告中的AI揭露:2024年5月,FCC要求政治廣告揭露AI軟體的使用情況,以應變AI生成的虛假聲音事件。

三、科技公司自律:在美國社會氛圍的壓力下,Meta和谷歌等科技巨頭自願在其平台上揭露AI生成內容,約 20 家科技公司自願承諾將合作創建浮水印和檢測工具,以識別欺騙性的AI內容。

歐盟的政策措施

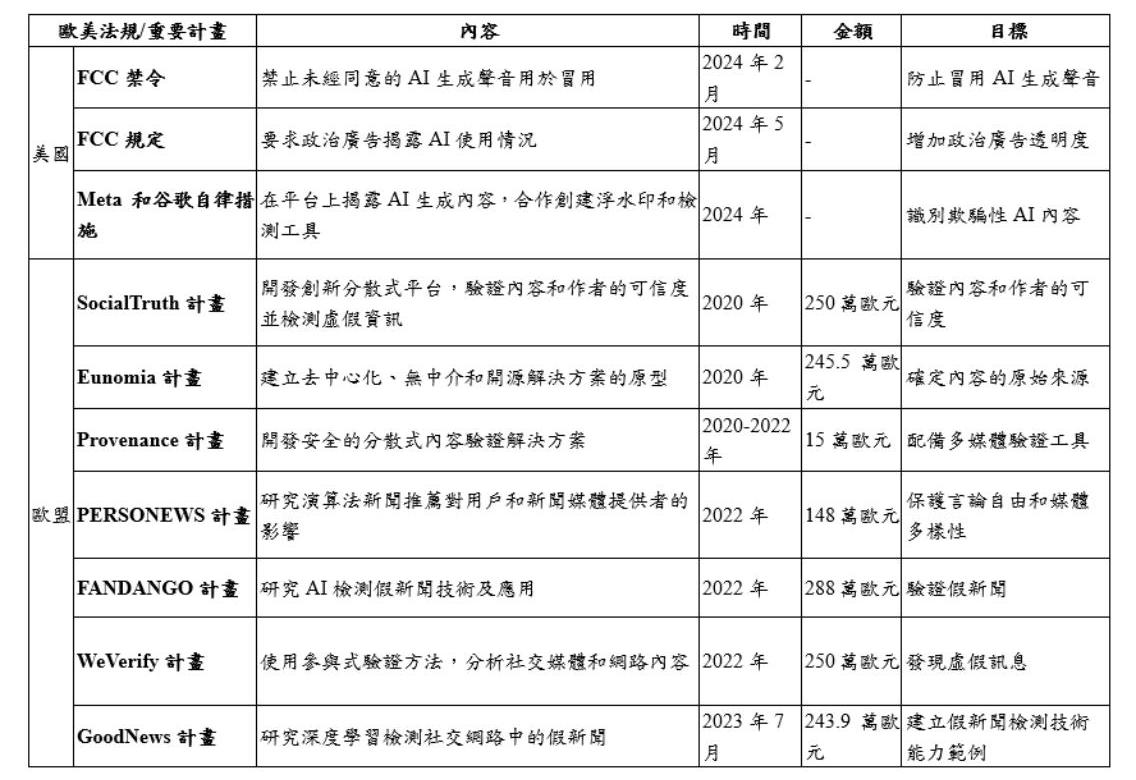

歐盟針對AI發展的打假(假冒、假新聞及詐欺等)的法規及政策,包含建立法規、成立委員會及發展打假技術,詳見下圖1。

一、社群媒體平台AI揭露原則:2022年歐盟通過數位服務法 (the Digital Services Act, DSA)及2024年甫通過的AI法,對生成式AI系統規定了相關義務,該系統產生逼真的視訊、圖像、音訊和文字內容,卻產生了社會及民主風險,包括干預人民政治選擇、進行恐怖主義宣傳、未經同意使用AI製造或傳播親密圖像,因此生成系統的提供者必須確保其輸出被標記為人工生成或操縱,同時能被社群媒體平台揭露、標記其使用AI內容。

二、禁止高風險AI系統:2024年5月歐盟通過的AI法第 5 條是防止透過人工智慧引入或加劇社會分裂、邊緣化或不民主的權力集中的重要保障。例如,禁止使用「潛意識技術,扭曲人類行為及損害認知決策,從而導致重大傷害」的系統;此外,涉及司法和民主進程的所有系統,包括用於影響選舉結果或投票行為的系統,都列為高風險類別,並須遵守其嚴格的附款要求。換句話說,使用AI製造假新聞而影響選舉結果或投票行為的系統,都將屬於高風險類別。

三、AI監管委員會機制:AI法(第 41 條)建立委員會機制,進行了AI風險審查,以限制委員會於通過及實施法案的裁量權,為高風險AI系統和通用AI系統建立通用技術規範。

四、資助AI打假科技研發計畫:

1.檢測社交媒體上的虛假資訊:2020年歐盟補助SocialTruth計畫約250萬歐元(約8,500萬元新台幣)開發一個創新的分散式平台,旨在驗證內容和作者的可信度並檢測社交媒體上的虛假資訊;該平台包括一個「數位夥伴(Digital Companion)」,可供專業人士(即專業人士)使用。

2.線上驗證內容變得更容易: 2020年歐盟補助Eunomia計畫約245.5萬歐元(約8,350萬元新台幣),專案正在建立一個去中心化、無中介和開源解決方案的原型,用於確定社交媒體上某條資訊內容的原始來源,讓線上驗證內容變得更容易:

(1)研究各種社群媒體用的AI技術,對於使用者影響,及否合乎法律和道德要求;

(2)設計和開發支援 EUNOMIA 可信度驗證和評分技術,例如其所需的去中心化等技術;

(3)將開發的技術整合至完整的 EUNOMIA 平台及數位(打假)夥伴;

(4)宣傳專案成果,制定宣傳計畫及納入打假關係人,以提高計畫受益人數及成果。

3.假新聞內容驗證解決方案:2020年(至2022年)歐盟補助Provenance計畫約15萬歐元(約8,300新台幣),開發安全的分散式內容驗證解決方案,配備多媒體假新聞驗證工具和技術。

4.深度學習檢測社交網路中的假新聞:2023年7月歐盟補助GoodNews計畫約243.9萬歐元(約510萬元新台幣),研究深度學習檢測社交網路中的假新聞,及應用深度學習技術,達成偵測假新聞之目的。例如使用新的演算法(如新型幾何深度學習演算法),以建立社交媒體中假新聞檢測的技術範例,及分析社交網路中的新聞傳播模式。

5.AI檢測假新聞技術及應用: 2022年歐盟補助FANDANGO計畫約288萬歐元(約9,800萬元新台幣)研究AI檢測假新聞技術及應用,驗證不同類型的新聞數據、媒體來源、社交媒體、開放數據,以檢測假新聞;同時,歐盟補助WeVerify計畫約250萬歐元(約台幣8,500萬元新台幣),使用參與式驗證方法、開源演算法、機器學習及直覺性視覺化等方法,分析社交媒體和網路內容以發現虛假訊息。

6.言論自由和媒體多樣性的持續保護:2022年歐盟補助PERSONEWS計畫約148萬歐元(約5,000萬元新台幣)研究演算法對新聞推薦及新聞媒體提供者的影響,及可以採取哪些保障措施及創新模式,以確保對言論自由和媒體多樣性的持續保護。

建議措施

本文建議數發部及NCC應借鑒歐美AI法規範及政策發展(詳見下表1),盡速立AI法及數位服務法、成立AI風險評估委員會及補助打假技術,前者法規應建立機制禁止未經當事人同意,使用AI生成及冒用聲音用於詐欺,並要求數位平台商就政治廣告或涉及公益的資訊揭露AI使用情況,及積極配合識假、下(架)假及打詐等業務。

同時,數位發展部應提出政策,鼓勵國內資安廠商開發浮水印和AI生成檢測工具,以識別及標記詐欺型AI生成內容。

再者,數位發展部及國科會應借鑒歐盟AI打假相關計畫,設立專用經費,支持國內學界、研發法人及國內自主資安公司,開發AI打假及檢測工具,及鼓勵參與國際科技合作和交流,學習和引進AI打假等先進技術,提升我國在AI打假和數位韌性方面的技術水平。

最後,數位發展部、內政部(刑事警察局)及法務部(調查局)也應提升公眾使用AI的風險意識,即提高民眾對AI生成假訊息的識別能力和防範意識,例如透過媒體和教育機構,廣泛宣傳和普及相關知識,建立全民防範和應對AI假訊息的意識。